近日,内蒙古包头等多地出现AI换脸新骗局,单笔被骗金额高达400余万,引发广泛关注。

5月24日,中国互联网协会发文提醒,不法分子利用AI技术,通过声音合成,伪造成特定人物的声音,通过AI换脸,伪装成特定人物,实时与他人进行视频通话。更换后的面部表情自然,以假乱真,能够冒充他人身份联系被害人,博取被害人信任后实施诈骗。面对利用AI技术的新型骗局,广大公众需提高警惕,加强防范!

据中新经纬,目前制作一套“露脸且说话”视频成本低至数十元,只需提供正面照就能生成视频,不仅眼睛、嘴巴、头会动,如果提供文字口型也能对上,一个晚上就能完工。有商家称用照片生成一段1分钟时长的视频仅需30元左右。如果视频时间短。质量要求不高几块钱一段都可以。

中国互联网协会:警惕!“AI换脸”新骗局

据中国互联网协会5月24日消息,今年以来,ChatGPT和GPT-4等技术的应用,成为了信息科技领域的热点,引起公众对AI技术的广泛关注和热情。但伴随着深度合成技术的开放开源,深度合成产品和服务逐渐增多,利用“AI换脸”“AI换声”等虚假音视频,进行诈骗、诽谤的违法行为屡见不鲜。

近期,包头市公安局电信网络犯罪侦查局发布一起使用智能AI技术进行电信网络诈骗的案件。不法分子利用AI技术,通过声音合成,伪造成特定人物的声音,通过AI换脸,伪装成特定人物,实时与他人进行视频通话。更换后的面部表情自然,以假乱真,能够冒充他人身份联系被害人,博取被害人信任后实施诈骗。

面对利用AI技术的新型骗局,广大公众需提高警惕,加强防范!

01 做好个人信息安全第一责任人

1、加强个人信息保护意识,防止信息泄露:不轻易提供人脸、指纹等个人生物信息给他人;不要轻易透露自己的身份证、银行卡、验证码等信息;不要贪图方便把身份证、银行卡照片等直接共同存放于手机内。

提示:发现APP过度、强制收集个人信息,请至12321.cn投诉。

2、陌生链接不要点,陌生软件不要下载,陌生好友不要随意添加,不明二维码不要随意扫描。管理好自己的朋友圈,也不要轻易向陌生人开启手机屏幕共享。

3、做好个人防护,安装安全软件,防止手机和电脑中病毒。对个人账户的安全状况保持警惕,尤其是陌生设备的登陆情况,防止微信、QQ等被盗号给亲朋好友带来麻烦。

4、对于不常用的APP,建议卸载前注销个人帐号。

△提示:APP不提供个人帐号注销方式,或为注销帐号设置各类障碍的,请至12321.cn投诉。

02 远程转账务必需要多重验证,把好“钱袋子”

如果有人自称“家人”“朋友”“老师”“领导”通过社交软件、短信、电子邮件等以“手机掉水里了,学校需要紧急交辅导班学费”“人在境外旅游,需要帮忙买机票”“给领导办私事,需紧急转账”“遭遇车祸,需要马上手术”“情况特殊,需要过桥资金拆借”等各种方式和理由诱导你转账汇款,务必第一时间提高警惕!

在AI时代,文字、声音、图像和视频都有可能是深度合成的。在转账汇款、资金往来这样的典型场景,要通过回拨对方手机号等额外通信方式核实确认,不要仅凭单一沟通渠道未经核实就直接转账汇款!无论对方是谁!

△提示:遭遇诈骗信息,请至12321.cn反诈专栏举报,如发生资金损失请及时报警。

一直以来,中国互联网协会不断推进行业自律,积极开展防范治理电信网络诈骗工作。2023年6月14-16日,中国互联网协会将组织举办“2023年电信网络诈骗治理工作培训”,解读电信网络诈骗治理法律法规,分析研判电信网络诈骗治理的重点工作和发展形势,助力企业落实防范治理电信网络诈骗责任,提高管理能力,促进行业健康发展。

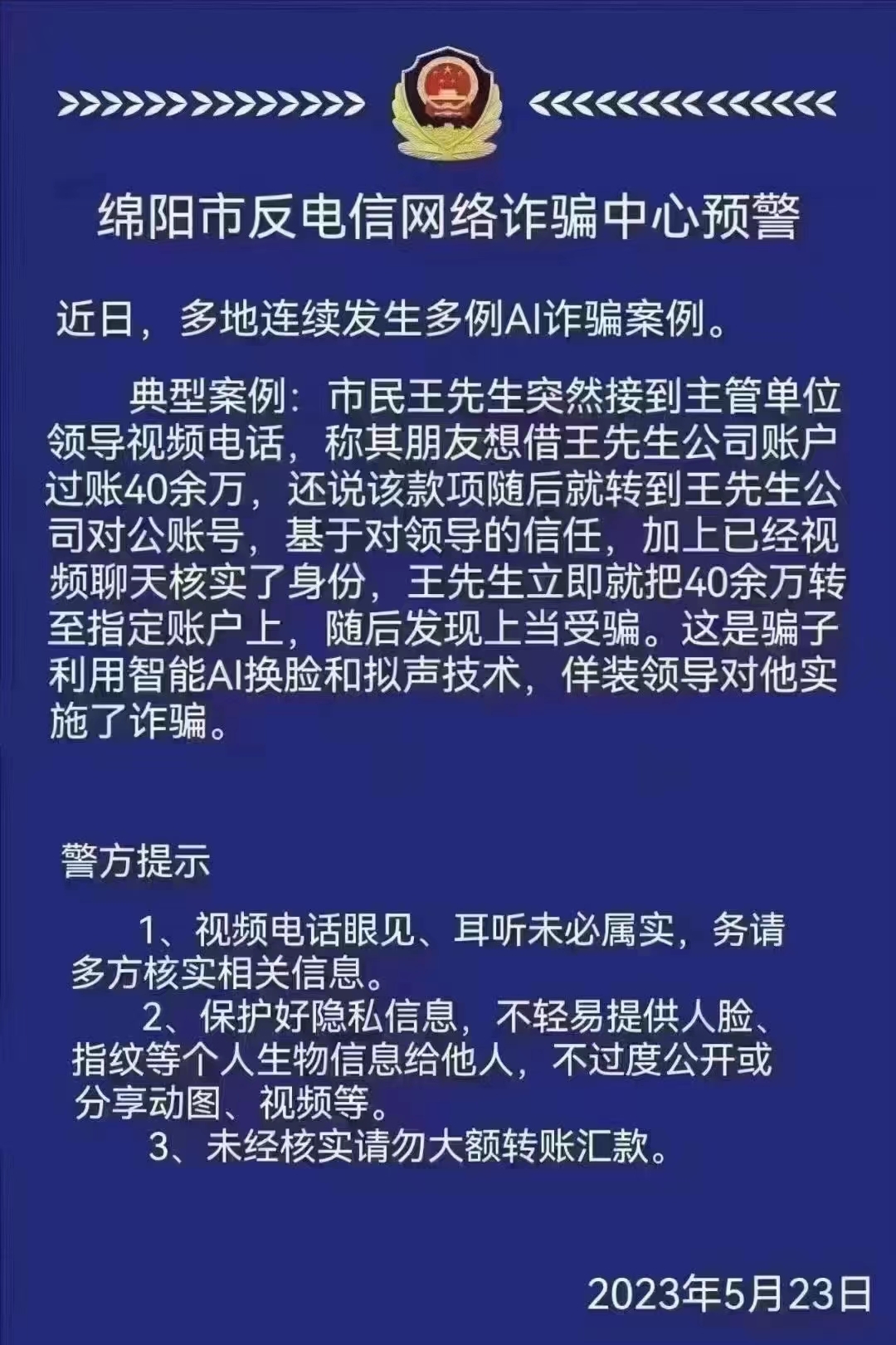

四川绵阳:骗子利用AI换脸和拟声技术佯装领导,一市民被骗40余万

5月23日,四川绵阳市反电信网络诈骗中心发布预警称,近日,多地连续发生多例AI诈骗案例。

典型案例:市民王先生突然接到主管单位领导视频电话,称其朋友想借王先生公司账户过账40余万,还说该款项随后就转到王先生公司对公账号,基于对领导的信任,加上已经视频聊天核实了身份,王先生立即就把40余万转至指定账户上,随后发现上当受骗。这是骗子利用智能AI换脸和拟声技术,佯装领导对他实施了诈骗。

警方提示

1、视频电话眼见、耳听未必属实,务请多方核实相关信息。

2、保护好隐私信息,不轻易提供人脸指纹等个人生物信息给他人,不过度公开或分享动图、视频等。

3、未经核实请勿大额转账汇款。

内蒙古包头:科技公司老板10分钟被骗走430万元

据平安包头官方微信号5月20日消息,5月8日,包头市公安局电信网络犯罪侦查局发布一起使用智能AI技术进行电信诈骗的案件。

4月20日11时40分左右,福州市某科技公司法人代表郭先生的好友突然通过微信视频联系到他,两人经过短暂聊天后,好友告诉郭先生,自己的朋友在外地投标,需要430万元保证金,且需要公对公账户过账,所以想要借用郭先生公司的账户走一下账。好友向郭先生要了银行卡号,声称已经把钱打到郭先生的账户上,还把银行转账底单的截图通过微信发给了郭先生。基于视频聊天信任的前提下,郭先生没有核实钱是否到账,于11时49分先后分两笔把430万元给对方打了过去。钱款转账后,郭先生给好友微信发了一条消息,称事情已经办妥。但让他没想到的是,好友回过来的消息竟然是一个问号。

郭先生拨打好友电话,对方说没有这回事,他这才意识到竟然遇上了“高端”骗局,对方通过智能AI换脸技术,佯装成好友对他实施了诈骗。

“从头到尾都没有和我提借钱的事情,就说会先把钱给我打过来,再让我给他朋友账户转过去,而且当时是给我打了视频的,我在视频中也确认了面孔和声音,所以才放松了戒备”,郭先生说。

4月20日12时21分,包头市电信网络犯罪侦查局接到福建省福州市公安局刑侦支队的外协请求,称福建省一知名民营企业负责人被骗走430万元,而涉案的银行卡为包头市蒙商银行对公账户,希望包头警方能够帮忙进行紧急止付。

包头市公安局电信网络犯罪侦查局立即启动“包头市警银联动绿色查询机制”,当班民警以最快速度完成核查、报审程序,第一时间将涉案卡的信息通报至蒙商银行相关部门。在银行的全力协助下,仅用时10分钟,就将该诈骗账户内的336.84万元被骗资金成功拦截。

同时,向福州市公安局警方提供了剩余款项93.16万元资金流出信息,为深入突破该案剩余资金查找提供了突破方向。目前,福建警方与包头警方对此资金正在全力追缴当中。

每日经济新闻综合自中国互联网协会、平安包头官方微信号、中新经纬

换成“朋友”诈骗 换成“明星”卖货

AI换脸还是AI“偷脸”?

点开直播间乍一看,卖货的竟是当红女星。再定睛一看,“明星”其实是使用人工智能(AI)实时换脸技术的普通主播。他们冒充明星艺人,只为增加卖点,助力卖货……

近期,“AI换脸”的应用范围越来越广,但存在滥用之嫌,甚至有人利用AI换脸实施犯罪,例如伪造不雅视频、换脸诈骗等。前不久,就有一男子因AI“偷脸”,10分钟被骗430万元。

如此以假乱真,让人防不胜防。“AI换脸”的法律边界在哪?普通人又该如何防范?

AI诈骗常用手法

第一种

声音合成

骗子通过骚扰电话录音等来提取某人声音,获取素材后进行声音合成,从而可以用伪造的声音骗过对方。

第二种

AI换脸

人脸效果更易取得对方信任,骗子用AI技术换脸,可以伪装成任何人,再通过视频方式进行信息确认。

骗子首先分析公众发布在网上的各类信息,根据所要实施的骗术,通过AI技术筛选目标人群。在视频通话中利用AI换脸,骗取信任。

第三种

转发微信语音

骗子在盗取微信号后,便向其好友“借钱”,为取得对方的信任,他们会转发之前的语音,进而骗取钱款。

尽管微信没有语音转发功能,但他们通过提取语音文件或安装非官方版本(插件),实现语音转发。

第四种

AI程序筛选受害人

骗子利用AI来分析公众发布在网上的各类信息,根据所要实施的骗术对人群进行筛选,在短时间内便可生产出定制化的诈骗脚本,从而实施精准诈骗。

诈骗\

公司老板遭遇AI换脸诈骗 10分钟被骗取430万元

近日,内蒙古包头警方发布一起利用AI实施电信诈骗的典型案例。

来自福建的郭先生是一家科技公司的法人代表。今年4月,他的好友突然通过微信视频联系他,称自己的朋友在外地竞标,需要430万元保证金,想借用郭先生公司的账户走账。

基于对好友的信任,加上已经视频聊天“核实”了身份,郭先生在10分钟内,先后分两笔把430万元转到了对方的银行账户上。

事后,郭先生拨打好友电话才得知被骗,原来骗子通过AI换脸和拟声技术,佯装好友对其实施诈骗。“当时是给我打了视频的,我在视频中也确认了面孔和声音,所以才放松了戒备。”郭先生事后说。

魔幻一幕令人吃惊,但这并非AI换脸第一次作恶了。

2022年2月,有位陈先生到浙江温州市公安局瓯海分局仙岩派出所报案称,自己被“好友”诈骗了近5万元。经警方核实,诈骗分子利用陈先生好友“阿诚”在社交平台发布的视频,截取其面部视频画面后再利用“AI换脸”技术合成,制造陈先生与“好友”视频聊天的假象骗取其信任,从而实施诈骗。

2021年拱宸桥派出所接到报警,受害人小陈称他在与女网友视频聊天后被对方敲诈勒索。经警方调查,对方利用AI换脸技术,将小陈视频中的面部合成到不雅视频中,借此对其实施勒索。

2020年,上海某公司高管因对方使用AI换脸与人工生成的语音技术制作公司领导的面孔,并要该高管转账,致使该高管被诈骗150万元。

直播\

换脸后的“杨幂”“刘亦菲” 都在直播间里带货

据紫牛新闻,“看了好几个直播间,我都惊呆了,要么是佟丽娅,要么是迪丽热巴,全都把脸换成明星带货了,那还要我们这些普通的主播干什么?”日前,一位网友在社交平台发文吐槽,她在逛某短视频软件的时候刷进了某品牌的直播间,直播间中的女主播正在热情推销商品,但这位女主播看起来似乎有点眼熟,直播弹幕中也有网友表达了相同的困惑,“主播像佟丽娅。”

在这位博主的帖子下,这类“明星脸”眼熟的巧合似乎未免有些太多了,网友“小虫”表示,这个品牌的直播间自己前几天也曾刷到,“那个是AI,我前几天刷到的,是另一个人,今天是佟丽娅。”网友“可乐”则回复说“刚刚看了下,还有一个号,好像是杨颖。”除了在这个牌子的直播间,也有网友刷到了其他“明星脸”的主播,“昨天我刷到殷桃,好吓人啊。”“我还看过一个一直用杨幂的脸的。”“上次还刷到了刘亦菲呢。”

据中新财经,随着AI技术的不断进步,AI实时换脸已逐渐成熟。近年来,AI实时换脸已从最初的娱乐“整活”,向直播等多个应用场景发展。通过智能后台的AI换脸技术,主播可以实现形象的实时替换。

有视频换脸研究者表示,实时换脸不存在延迟,也不会有Bug,而直播画面传输的延迟则取决于使用者的网络配置和进行直播的平台。

中新财经记者以使用者的身份咨询了一家提供“换脸软件”的网站。该网站客服表示,使用AI换脸需要进行模型训练。“合成效果好不好,关键看模型和素材。”

据提供“换脸软件”的网站介绍,使用者自己从零开始训练模型,如果24小时挂机不停的训练模型,需要经过半个月到一个月的时间,才能达到可以合成视频的效果。

而比起自己花费大量时间训练模型,更多人选择购买现成的模型。“素材充足的话,你只要花费半个小时到几个小时的时间就可以直接合成视频。模型可以替换任意素材使用,不分张三李四。”

该网站客服称,他们提供的全套模型购买价格为3.5万元,AI实时换脸可适用于各大直播平台。

行业\

必须尽快立规 明确信息保护红线

为规范人工智能发展,去年12月,《互联网信息服务深度合成管理规定》正式发布,明确了合成数据和技术管理规范。其中提到:深度合成服务提供者对使用其服务生成或编辑的信息内容,应当添加不影响使用的标识。提供智能对话、合成人声、人脸生成、沉浸式拟真场景等生成或者显著改变信息内容功能的服务的,应当进行显著标识,避免公众混淆或者误认。

简单来说,这些技术服务公司,不能随便使用普通人的人脸来换脸,必须经过本人同意,换脸不是想换就能随便换,也不是骗子给钱就能随便换。

近期,也有平台和企业发布了“关于人工智能生成内容的平台规范暨行业倡议”,明确禁止利用生成式人工智能技术创作、发布侵权内容,包括但不限于肖像权、知识产权等,一经发现,平台将严格处罚。

当然,人工智能开发还是一个高速成长的领域,规则的健全完善还需要时间。但不管怎么说,此次案件都提醒我们,技术被滥用的风险,对普通人造成的安全隐患和威胁,绝对不容低估。

对大众来说,在人工智能时代,我们得更加警惕,不要随意泄露个人信息,需要转账时应更加谨慎地核实。而对行业而言,必须尽快立规,明确信息保护红线,加强对技术服务商行为的规范引导,等等。

律师说法\

律师:或侵犯肖像权、名誉权

据安徽商报,北京盈科(合肥)律师事务所王海波律师称,“‘AI换脸’属于深度合成技术,随意使用可能有肖像权和名誉权侵权的风险。”

王海波称,按照民法典规定,无论个人还是平台、软件开发商,未经肖像权人同意,通过技术手段提取肖像,并擅自使用或上传至换脸App中供用户选择使用的行为都涉嫌侵害了他人肖像权,如果有人将他人的脸换到不雅视频中,或者利用换脸软件对他人进行恶意丑化,就有可能侵犯他人的名誉权。

据中国之声,北京岳成律师事务所高级合伙人岳屾山律师表示,这样的换脸直播用于公开传播,可能涉嫌侵犯相关明星艺人的肖像权,如果涉及直播带货等商业行为,会成为加重情节。

在知名艺人工作室从事宣传工作的袁女士表示,“我经常刷一些平台都会看到。还是有一定的欺骗性的,如果不仔细辨认的话,就会认为是明星艺人本人,这一点我觉得还挺可怕的,万一卖的东西拿回去了以后货不对板,或者有一些更严重的问题,消费者就会觉得‘这个东西我是看着谁谁谁的脸去买的’,或者说‘我是进了谁的直播间去买的’。”

袁女士认为,针对相关行为搜集证据和维权的成本比较高。而只要冒用了明星艺人的面部特征,不管是否提及姓名,侵权影响都类似。“说实话是没有差别的,因为他本质上还是用这个明星的脸去做文章。如果我负责的明星艺人摊上了这个事儿,其实维权成本特别大,并且效果可能没那么好。我们也不可能每天都去发律师函,发也发不过来,甚至有的时候可能要找到侵权人都很费劲。”

声音

整治AI换脸

要用法打败“魔法”

“短短10分钟,被骗430万元”“换脸冒充当红女星带货,赚得盆满钵溢”……这种“换脸”术和拟声术,让人防不胜防。如此种种,无不说明换脸术的滥用,已经对公共利益构成威胁。

整治AI换脸,当用“法”打败“魔法”。

这个法,是方法、办法的法。有人说,防骗最有效的一招就是不信,无论对方怎么“换”、怎么变、怎么翻着花样骗,就是“不听不信不转账”。最关键的是,优化“打法”,升级高招,用更有效的方法“破防”。“魔高一尺,道高一丈”,面对骗子的新招数,我们的反诈术、防骗方法更要优化,总结出富有成效的好方法,并做好宣传普及,构筑反诈防骗的全民阵线。

这个法,也是法规、法律的法。此前,一款主打AI换脸的App很火,“只需一张照片,演遍天下好戏”。但很快,在监管部门约谈后,这款App下架,原因很简单,如此换脸侵犯了公民的肖像权。去年12月,《互联网信息服务深度合成管理规定》发布,对人脸生成、替换、操控,合成人声、仿声等都有明确约束。显然,随着制度设计更精准,相关立法更健全,AI换脸空间将越来越逼仄。

AI换脸术滥用,也促使大家思考一个深层次问题。新技术不断面世,带给了人们便利,但可能被居心叵测之徒非法利用。人们固然不能因噎废食,但也不能忽略它的双刃剑效应。如果缺乏应有规束,AI换脸则可能打开潘多拉魔盒。因势利导,使其趋利避害,这是我们要全力做到的。

综合央视新闻微信公众号、央广之声、每日经济新闻

核心观点:中国经济网评论员臧梦雅认为,用户对人工智能的需求越来越细化,互联网应用的场景深度也在不断加强,这就对相关领域的监管提出了更高要求,尤其是各大平台必须担起相应的责任。

“AI换脸”、“AI翻唱”等应用爆火网络,想必网友们已经不再陌生。近年来,AI狂潮之下,“换脸”已从最初的娱乐向直播等多个应用场景扩展。点进直播间,用户还以为是哪个明星在带货,仔细一看,却发现是主播进行了“AI换脸”,这以假乱真的程度让观看直播的用户直呼“被诈骗”。

虚拟世界也不是法外之地,“AI换脸”的巨大隐患正是版权问题。对此,民法典明确规定,任何组织或者个人不得以丑化、污损,或者利用信息技术手段伪造等方式侵害他人的肖像权。未经肖像权人同意,不得制作、使用、公开肖像权人的肖像,但是法律另有规定的除外。

说起来,这些主播未必不知道自己的行为侵犯了明星的肖像权。然而,如今直播间竞争激烈,很多主播不得不通过一系列“博眼球”的操作来“求关注”,以获得更高流量,吸引更多客源,获取经济价值。在“流量至上”和“利益至上”的理念驱使下,使用“明星脸”直播,正好能够达到引流并节省直播成本的效果。可以说,这些带货的主播就是在故意“蹭”明星的“热度”。

事实上,利用网络侵害肖像权案件权利主体所属领域集中,多见于演艺行业。在一些虚假代言案件中,侵权行为人以盗用、冒用姓名的方式,误导消费者相信其产品或服务与公众人物存在代言关系,以不当方式提升品牌知名度,这不但欺骗了消费者,而且会有损公众人物本人的信誉。尽管公众人物尤其是明星在享有的肖像权方面有一些让渡,但这些随意“换脸”的主播既“未经他人同意”,又“以营利为目的”,显然已经涉嫌违法,当心“吃不了兜着走”。

针对人工智能生成内容识别难、侵权问题多发等特点,今年4月,国家互联网信息办公室发布《生成式人工智能管理办法(征求意见稿)》,要求尊重知识产权、商业道德,不得利用算法、数据、平台等优势实施不公平竞争。而某短视频平台也发布《关于人工智能生成内容的平台规范暨行业倡议》,提出应用生成式人工智能技术时,发布者应对人工智能生成内容进行显著标识,帮助其他用户区分虚拟与现实,特别是易混淆场景。

如今,用户对人工智能的需求越来越细化,互联网应用的场景深度也在不断加强,这就对相关领域的监管提出了更高要求,尤其是各大平台必须担起相应的责任。如果平台明知“AI换脸”直播有问题,却仍然“睁一只眼闭一只眼”,那么损害的将是市场的公平竞争和行业的长远发展,最终失去的将是商业信誉和广大用户。

人工智能的浪潮滚滚而来,虚拟和现实的边界不再清晰。人们在享受着科技进步为现实世界带来的红利同时,也很容易迷失在虚拟世界制造的假象中。在这样的情况之下,科技将走向何方,需要我们做出更为明智的选择。(中国经济网评论员 臧梦雅)

上一篇:联手打击交通事故“碰瓷党”

下一篇:直播间“金融大咖”给股民下套